基于Flink构建实时数仓实践 数据处理与存储服务

在当今大数据时代,企业对实时数据处理能力的需求日益增长。Apache Flink作为一款强大的流处理框架,结合实时数仓架构,能够高效处理海量数据并支持实时分析。本文将探讨如何基于Flink构建实时数仓,重点关注数据处理和存储服务的实践。

一、实时数仓架构概述

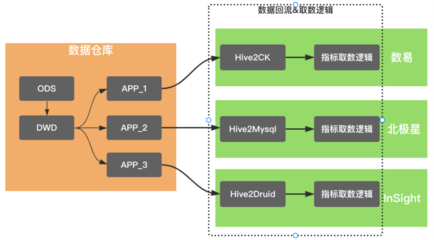

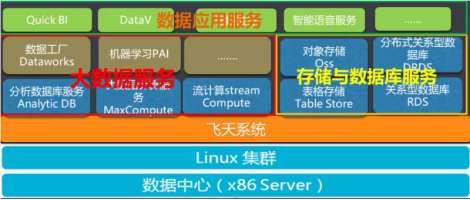

实时数仓旨在提供低延迟的数据处理和分析能力。其核心架构通常包括数据采集、数据处理和数据存储三个层次。Flink作为数据处理引擎,在实时数仓中扮演关键角色,支持复杂的事件驱动应用和流式ETL(提取、转换、加载)过程。通过Flink的容错机制和状态管理,系统能够在故障时快速恢复,确保数据一致性和可靠性。

二、数据处理服务实践

数据处理是实时数仓的核心环节。利用Flink,我们可以实现以下关键功能:

- 数据接入:通过Flink Connectors从Kafka、MySQL等数据源实时摄取数据。Flink支持多种数据格式(如JSON、Avro),并允许自定义源端适配器。

- 流式ETL:Flink提供丰富的操作符(如map、filter、window)进行数据清洗、转换和聚合。例如,在电商场景中,可以实时计算用户行为指标,如点击率或购买转化率。

- 复杂事件处理:Flink的CEP库支持检测数据流中的模式,例如识别异常交易或安全威胁。结合状态后端(如RocksDB),能够高效管理长时间窗口的聚合状态。

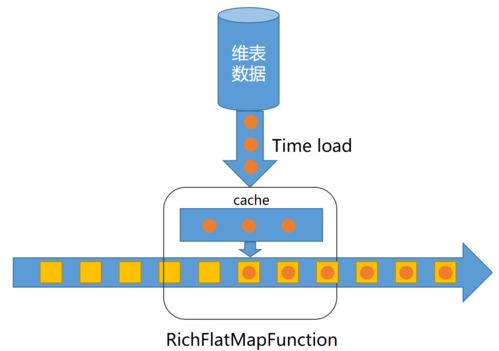

- 数据集成与关联:通过Flink SQL或Table API,可以轻松实现多流Join操作,将来自不同源的数据实时关联,生成统一视图。

三、数据存储服务实践

数据存储服务确保处理后的数据能够被高效查询和分析。在基于Flink的实时数仓中,存储方案需兼顾实时性和可扩展性:

- 实时存储:处理结果可写入OLAP数据库(如ClickHouse、Druid)或时序数据库(如InfluxDB),以支持低延迟查询。同时,Flink支持将数据同步到数据湖(如HDFS或S3),用于离线分析。

- 状态存储:Flink的状态后端(如文件系统或RocksDB)用于持久化中间状态,防止数据丢失。在高可用部署中,可配置分布式存储(如HDFS)作为状态后端。

- 数据服务层:通过API网关或查询引擎(如Presto)暴露数据接口,使业务系统能够实时访问处理结果。结合缓存技术(如Redis),可进一步提升查询性能。

四、实践案例与挑战

以一个电商实时监控系统为例,我们使用Flink处理用户行为流,计算实时指标(如销售额、活跃用户数),并将结果存储到ClickHouse中。通过Grafana仪表板,运营团队可实时监控业务动态。实践中需注意以下挑战:

- 数据一致性:在分布式环境中,需通过Flink的精确一次语义(exactly-once)保证数据处理不重不漏。

- 资源管理:合理配置Flink任务并行度和集群资源,避免性能瓶颈。

- 运维监控:集成监控工具(如Prometheus)跟踪任务状态和延迟,及时处理故障。

五、总结

基于Flink构建实时数仓,能够显著提升数据处理效率和实时分析能力。通过优化数据处理流程和存储服务,企业可以快速响应业务变化,驱动数据驱动的决策。未来,随着Flink生态的完善,实时数仓将在更多场景中发挥关键作用。建议在实施中结合具体业务需求,逐步迭代架构,并注重团队技能培养和运维自动化。

如若转载,请注明出处:http://www.lookmq.com/product/17.html

更新时间:2026-04-16 15:45:55